Hermes Agent 不完全指南,一个会自己长脑子的 AI Agent

Hermes Agent 不完全指南,一个会自己长脑子的 AI Agent上周五晚上,我在终端里敲了一行命令。

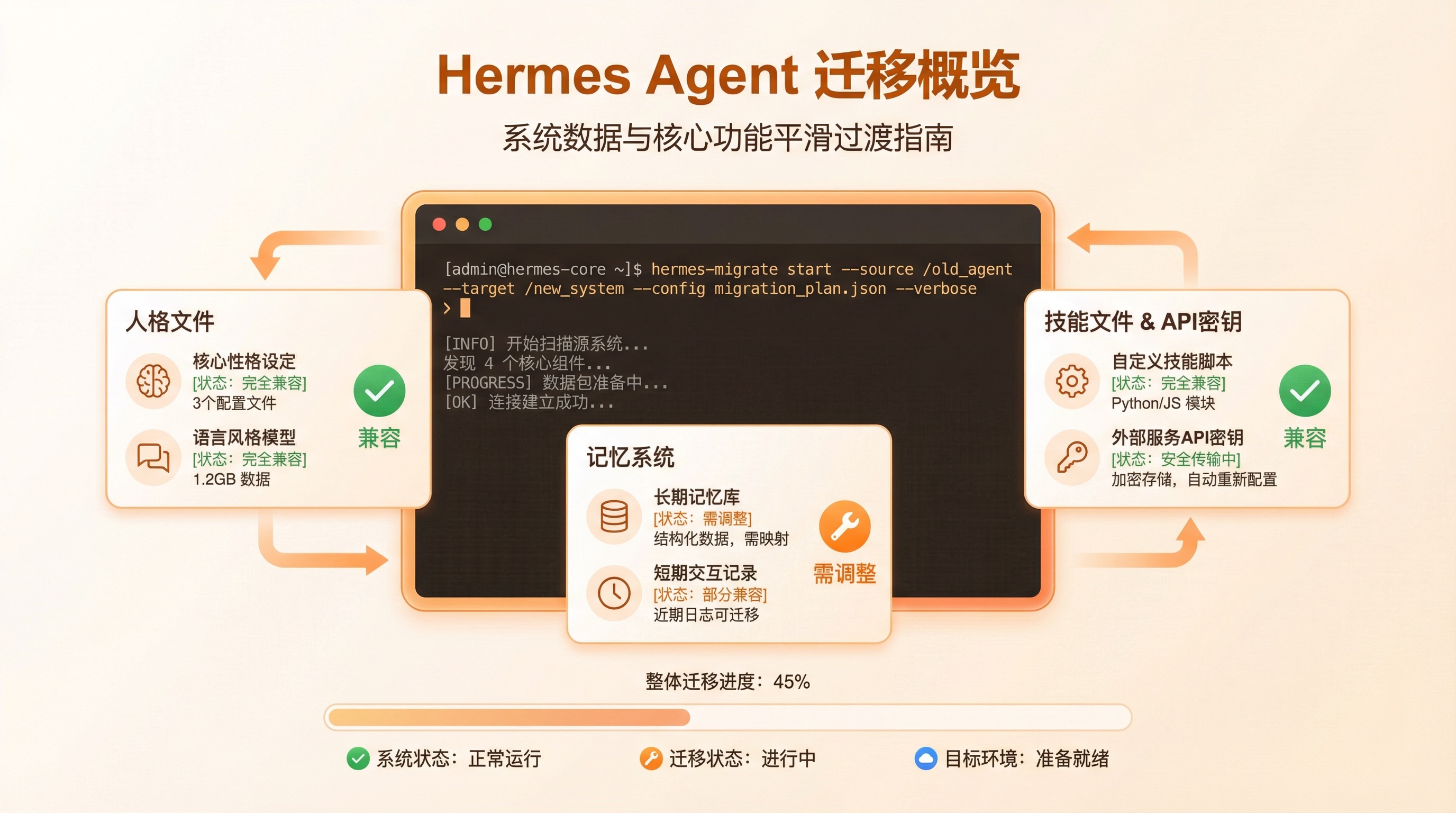

hermes claw migrate --dry-run

回车之后我就愣住了。

它检测到了我的 ~/.openclaw 目录。SOUL.md、MEMORY.md、所有自定义 Skills、API Keys,一个不落地列了出来。甚至还标注了哪些能完美迁移,哪些需要手动调。

我当时脑子里就一个想法,这是来抢人的。

Hermes Agent 是 Nous Research 做的开源 AI Agent。说真的,我之前对 Nous Research 的印象还停留在他们开源的那几个大语言模型上,没想到他们悄悄憋了个大招。

GitHub 上线 42 天,将近 4 万 Star。200 多个贡献者。这个数据放在 AI Agent 赛道里,不只是火了,是爆炸级的。

但 Star 数这东西你也知道,很多时候就是大家先 Star 了再说,真正用的人没几个。我自己是抱着「看看又是个啥」的心态开始翻它的文档的。

翻完之后我得说,这玩意确实有点东西。

它最大的卖点不是支持 15 个模型提供商,不是能 ...

Anthropic 发布最强模型 Claude Mythos,但不让你用

Anthropic 发布最强模型 Claude Mythos,但不让你用今天 Anthropic 做了一件前所未有的事:发布了一个模型,然后宣布不给你用。

Claude Mythos Preview,跑分数据断崖式领先,USAMO 数学证明从 42% 飙到 97.6%,SWE-bench Verified 代码修复冲到 93.9%——但对普通用户、开发者、企业客户来说,这个模型不存在。不上 claude.ai,不开 API。

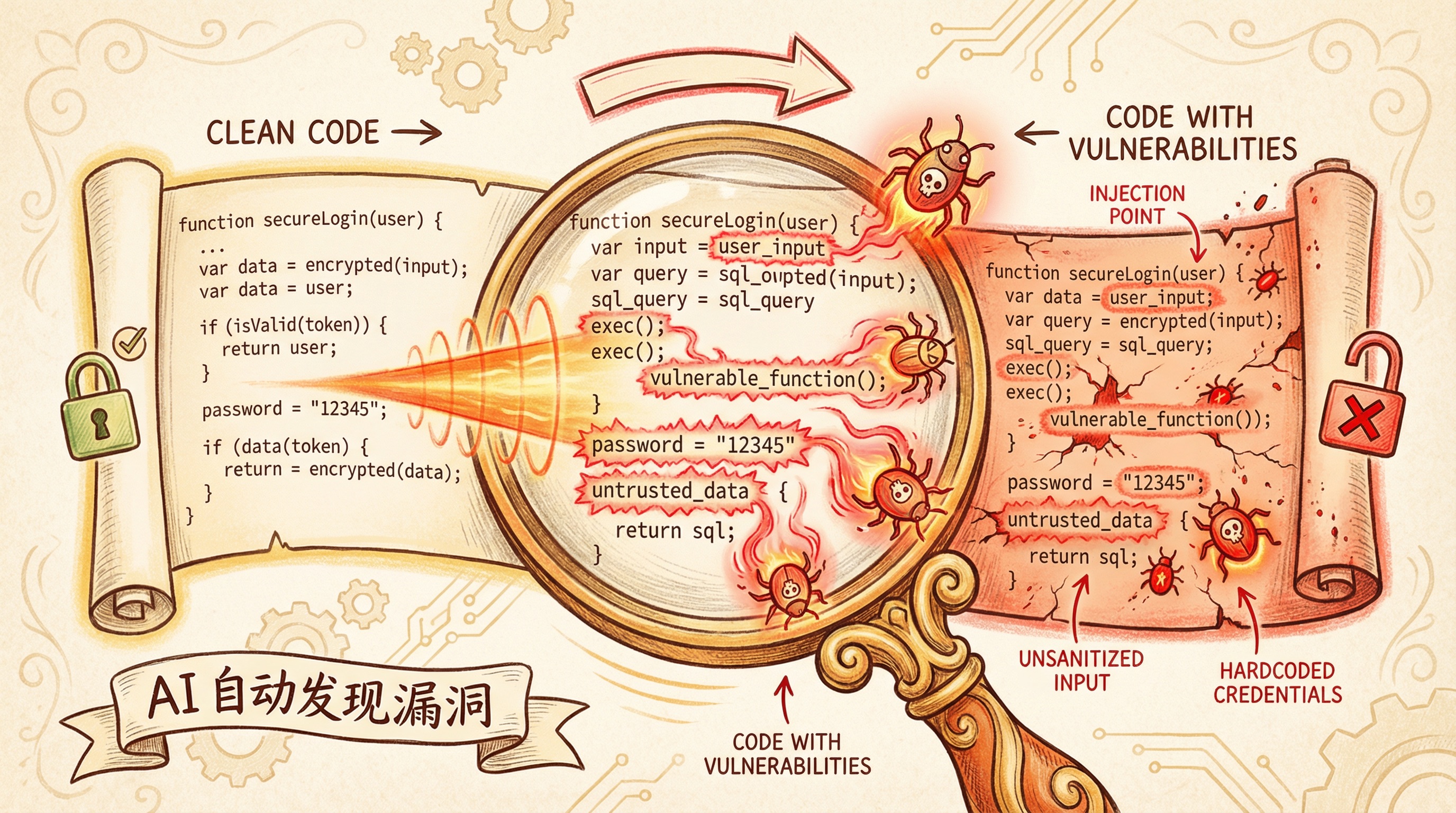

它只做一件事:找漏洞。

跑分炸裂,但你可以忽略先快速过一遍数据。Mythos 对比 Anthropic 上一代旗舰 Opus 4.6:

基准测试

Opus 4.6

Mythos Preview

SWE-bench Verified

80.8%

93.9%

SWE-bench Pro

53.4%

77.8%

USAMO 2026(数学证明)

42.3%

97.6%

GraphWalks BFS(超长上下文)

38.7%

80.0%

Terminal-Bench 2.0

65.4%

82.0%

USAMO 从四成直接拉到接近满分,这个 ...

YC 的 CEO 兼职 60 天写了 60 万行代码,他把方法开源了

YC 的 CEO 兼职 60 天写了 60 万行代码,他把方法开源了Andrej Karpathy 三月份在一个播客上说了句话,我听完之后愣了好一会儿。

「我大概从去年十二月开始就没怎么自己敲过代码了。」

Karpathy 啊。前 OpenAI 联合创始人,前特斯拉 AI 总监,现在自己做 AI 教育公司。这个级别的人说自己不写代码了,而且语气特别平静,就好像在说今天天气不错。

然后没过几天,我刷到了另一个人的数据。

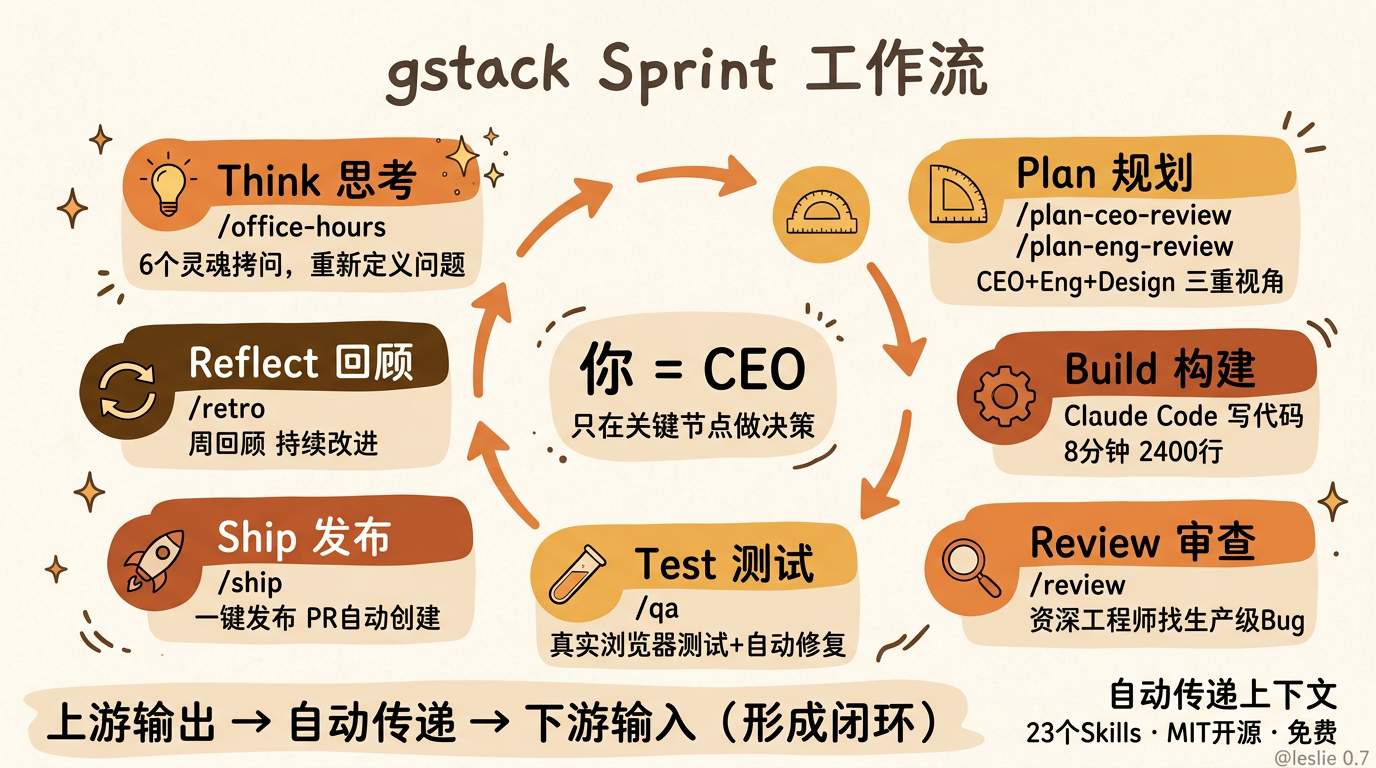

Garry Tan,Y Combinator 的 CEO。对,就是那个全球最出名的创业加速器的掌门人。他在 GitHub 上开源了一套叫 gstack 的工具,README 里贴了一组数字。

60 天,60 万行生产代码。35% 是测试。每天 1 到 2 万行。

而且他是兼职写的。白天要全职运营 YC,管理几千家创业公司。

他的一周 retro 截图显示,140,751 行新增,362 次提交,净增大约 11.5 万行代码。就一周。

我第一次看到这组数据的时候,第一反应是不信。

一个人,兼职,一周 11 万行?

我自己也天天用 Claude Code,状态最好的时候一天撑 ...

我文章里那些好看的信息图,都是这一个免费工具画的

我文章里那些好看的信息图,都是这一个免费工具画的最近有朋友问我,你文章里那些信息图是怎么画的,配色统一风格统一,看着像一个人做的。

我当时回了一句,确实是一个「人」做的,只不过这个人是 AI。

然后对方来了兴趣,追问用的什么工具。我想了想,觉得这个东西可能不止他一个人好奇,干脆写篇文章聊聊。

先说个背景。

我写文章有个习惯,每篇都会配信息图。不是随便找张网图凑数的那种,是根据文章内容专门做的。环形流程图、金字塔对比、中心辐射图、管线流程图,根据内容的结构来选合适的布局。

之前推荐 gstack 的那篇,5 张信息图。推荐 Skills 的那篇,好几张。还有其他几篇文章,加起来前前后后画了几十张了。

坦率的讲,这个量级如果是人工做,要么得请一个设计师,要么得花大量时间自己学设计软件。我一个写代码的,让我用 Figma 画信息图,画出来大概长这样,文字挤在一起,配色辣眼睛,排版全靠缘分。

但我用 AI 来画,画出来的效果你们也看到了。风格统一,配色舒服,信息层次清晰。

关键不是我有什么隐藏天赋。关键是工具选对了。

我用的这个工具叫 baoyu-skills。

它是一个开源的 Claude ...

当 AI 开始扮演你的同事、前任和老板

当 AI 开始扮演你的同事、前任和老板最近 Skills 生态里冒出了一类很有意思的东西——关系型 Skills。

不是让 AI 帮你写代码、做 PPT、搜资料,而是让 AI 扮演你生活中的某个角色。同事、老板、前任、你自己,甚至乔布斯和马斯克。GitHub 上相关的项目一个接一个冒出来,多语言 README、数千 Star。

这个话题已经出圈了。不是只有技术社区在讨论——「同事.skill 爆火,AI 正在吃掉职场经验?」「同事被炼化成了 Token,AI 能否偷走职场经验?」「当同事、老板、前任都被做成 Skill:人类正在被重新定价」……知乎热榜「同事.skill爆火」240 万热度,17 个回答、几十篇专栏文章。机器之心写了「疯狂的Skill」专题,新浪科技跟进报道,连心理学话题区都在讨论伦理问题。

一个 GitHub 上的开源项目,能在几天之内引发这么广泛的讨论,本身就说明它触动了什么。

乍一看是玩梗。但细看之后你会发现,这波东西背后藏着一个比技术本身更值得聊的话题。

它们都在做什么?同事.skill — 把离职同事变成 AIGitHub:https://github.co ...

用 Claude 自动化了一整天工作流,我总结出这些

用 Claude 自动化了一整天工作流,我总结出这些最近看到一个视频,SEO 创业者 Julian Goldie 做了一个一小时的 Claude 大师课,现场演示了用 Claude 构建落地页、自动化 SEO 内容、创建小程序、管理社交媒体——全程不写一行代码。

说实话,一开始我觉得这种标题又是一个”AI 万能论”的营销视频。但看完之后,我发现他演示的几个工作流设计思路确实有东西——不是 Claude 能做什么,而是怎么把 Claude 的能力编排成可复用的系统。

这篇文章不是视频的整理稿。我挑了他演示中最有价值的几个思路,结合我自己这段时间用 Claude 的体感,以及社区里的一些最佳实践,重新组织了一下。

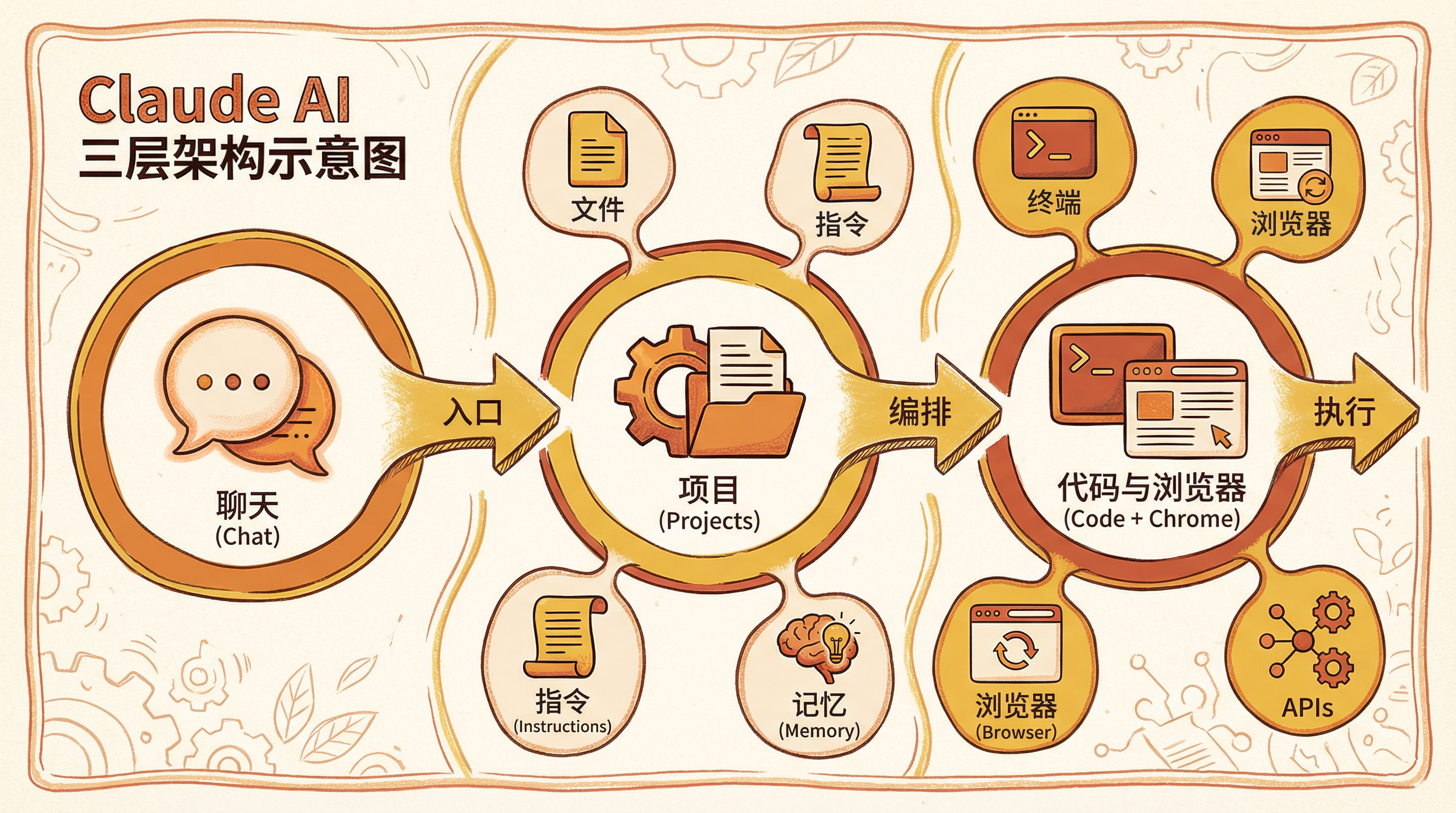

一、Projects:不是”项目”,是你的自动化机器人Claude 里面有个功能叫 Projects,很多人可能完全没注意过。它藏在侧边栏里,点进去才能看到。

Julian 现场演示了他的 Projects 列表——SEO 写作、推文创作、直播准备、YouTube 标题生成,每个都是一个独立的自动化工作流。

一个 Project 本质上是一个定制的 Claude 实例,包含三个 ...

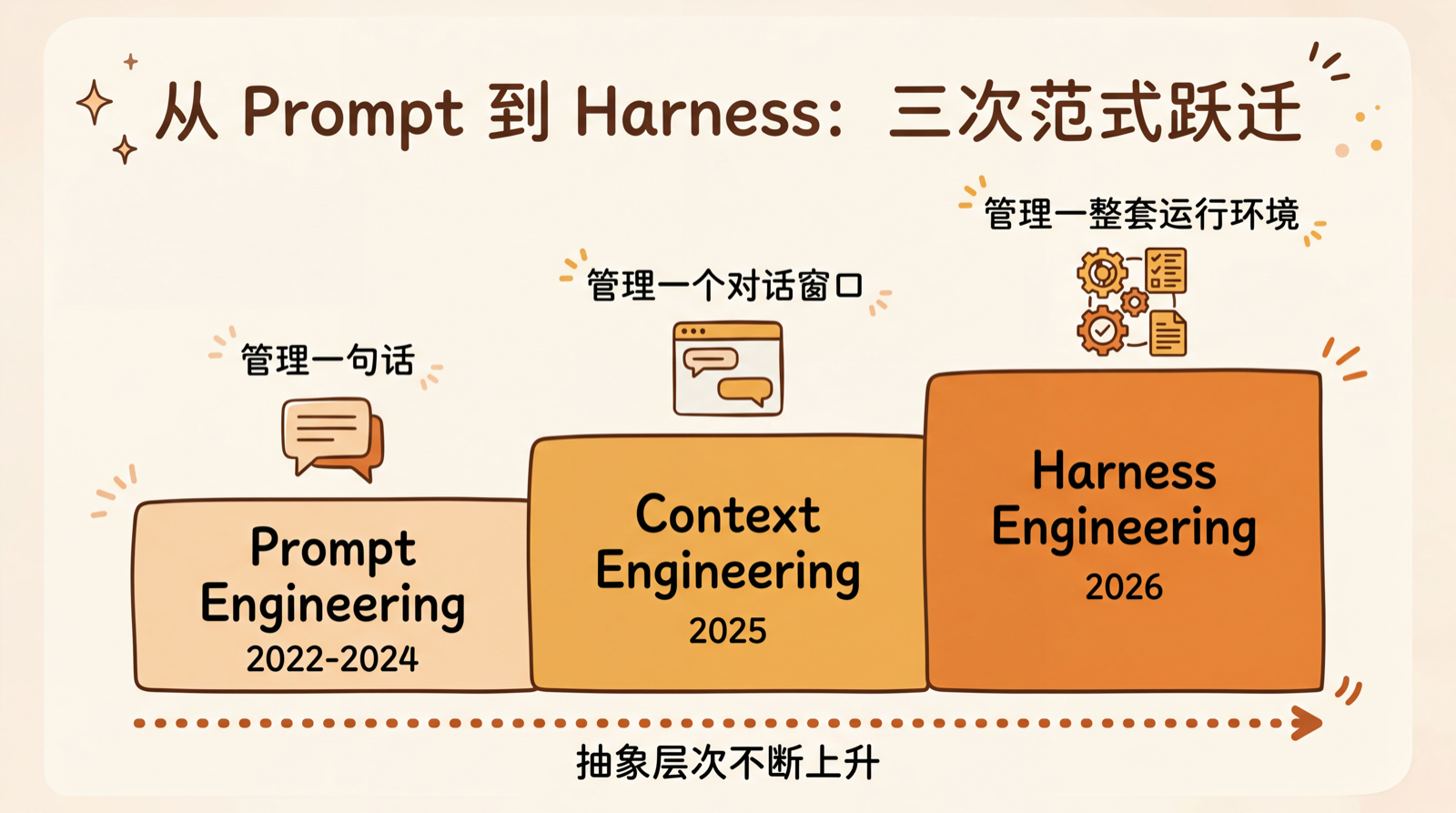

Harness Engineering:两周内从博客到行业共识的新工程学科

Harness Engineering:两周内从博客到行业共识的新工程学科引言2026 年 2 月 5 日,Mitchell Hashimoto(HashiCorp 创始人、Ghostty 终端作者)发了一篇博客,标题很朴素——“My AI Adoption Journey”。文中第五步,他写了这么一段话:

“I don’t know if there is a broad industry-accepted term for this yet, but I’ve grown to calling this harness engineering. It is the idea that anytime you find an agent makes a mistake, you take the time to engineer a solution such that the agent never makes that mistake again.”

两周后,OpenAI、Anthropic、Martin Fowler、Ethan Mollick、LangChain 全部跟进 ...

这 8 个 Skills,装了就回不去了

这 8 个 Skills,装了就回不去了前言最近 Skills 这个话题很火,社区里有不少推荐必装 Skills 的文章,反响不错,评论区也有不少讨论。

我看完之后,一方面觉得确实有不少好用的,另一方面也觉得可以从我自己的使用角度补充几个。所以这篇文章的结构是这样的:前 6 个来自社区热门推荐,我加上自己的实际体感;后 2 个是我自己在用的,觉得值得单独拿出来说说的。

在开始之前,先说一个我自己的判断标准:

好的 Skill 不是让 AI “能做某件事”,而是让 AI “做某件事的下限大幅提高”。

没有 Skill,AI 也能生成 Word、也能写前端页面、也能搜网页。但出来的东西质量波动很大,运气好还行,运气不好就是一坨。Skill 的价值在于把这个下限兜住——给 AI 一套经过验证的操作手册,让它不用每次从零摸索。

明确了这一点,我们开始。

一、Frontend Design

链接:https://github.com/anthropics/skills/tree/main/skills/frontend-design

Anthropic 官方出品,Claude 插件网站排名 ...

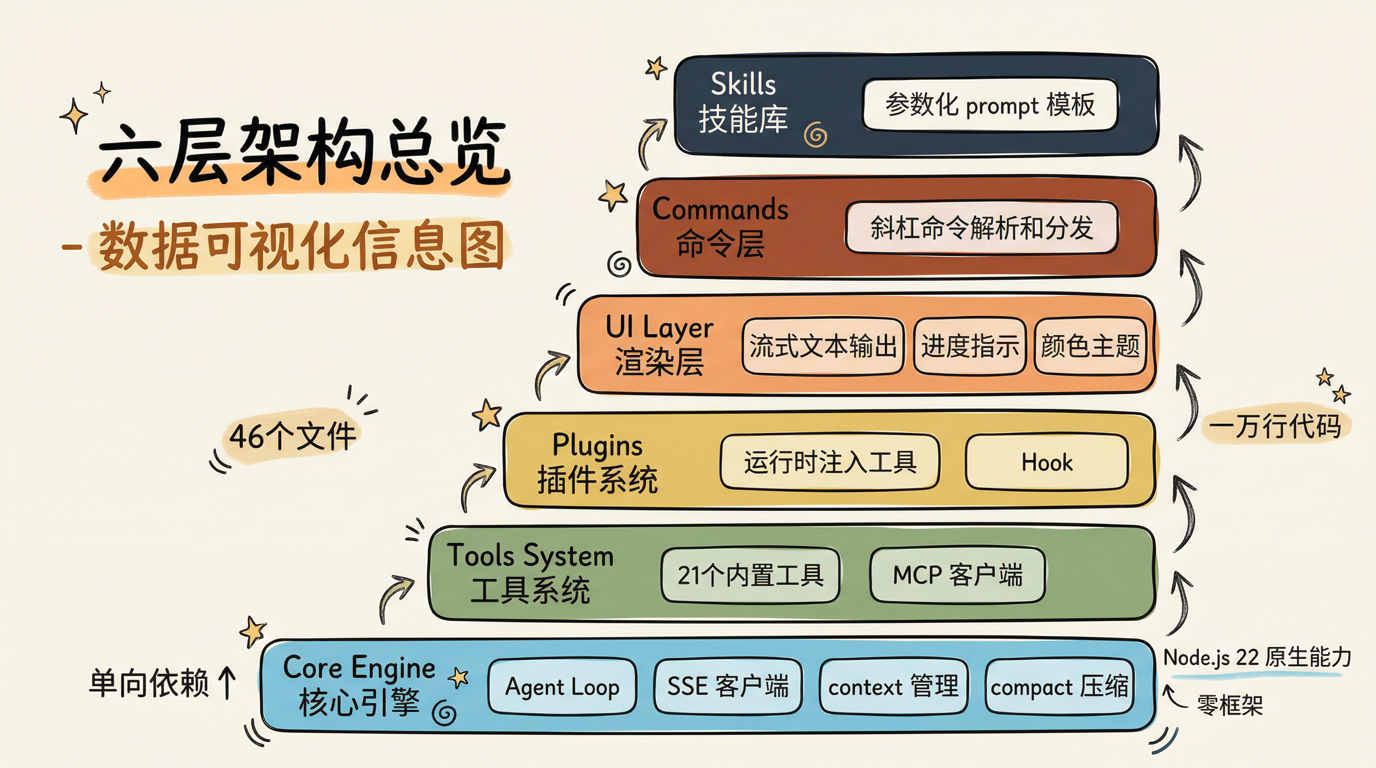

深入 Agentic CLI 架构:用 Claude Code 拆解它自己的七层设计

深入 Agentic CLI 架构:用 Claude Code 拆解它自己的七层设计引言很多人以为 AI 编码工具就是”套壳调 API”——拿到用户输入,发给大模型,把回复打印到终端。十行代码就能搞定。

但如果你真的尝试从零构建一个能操作文件系统、执行终端命令、管理多轮对话的 Agentic CLI,你会发现:调 API 确实是十行代码的事,剩下的九千九百九十行才是真正的工程。

于是我做了一件可能有点奇怪的事:用 Claude Code 来拆解 Claude Code 自己。

这种”拆解者就是被拆解的对象”的视角,能暴露出很多从外部看不到的工程细节。

1. 六层单向依赖:架构的骨架

一个 Agentic CLI 可以被拆成六层,依赖关系严格单向——上层依赖下层,反过来不行:

层级

职责

Core 引擎层

Agent Loop、SSE 流式客户端、上下文管理、compact 压缩

Tools 工具层

21 个内置工具 + MCP 外部工具客户端

UI 渲染层

终端流式文本输出、进度指示、颜色主题

Plugins 插件层

运行时注入工具和生命周期 hook

S ...

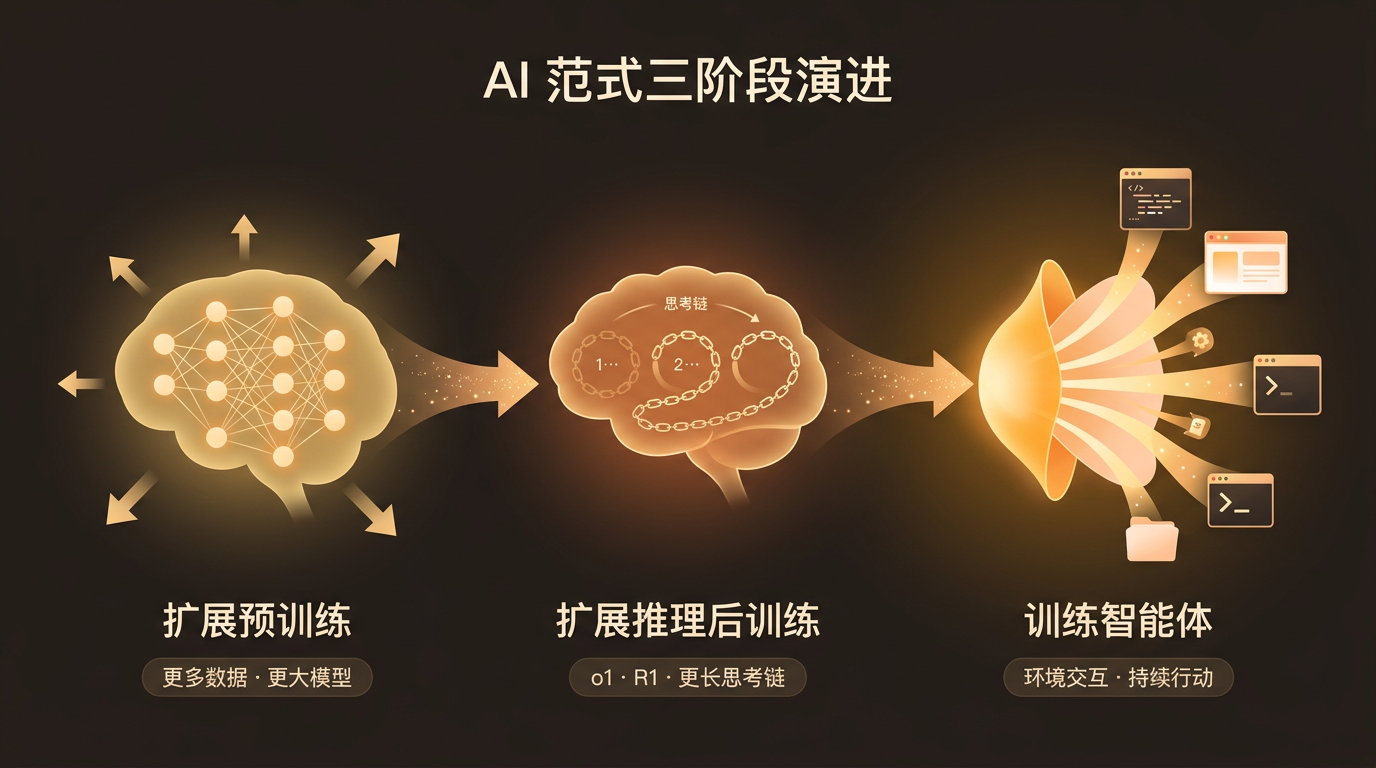

从"推理思维"到"智能体思维"

从”推理思维”到”智能体思维”

作者:林俊阳(Junyang Lin),通义千问 Qwen 团队原文发布于 2026-03-26

核心论点我们正在从”训练模型”的时代,过渡到”训练智能体”的时代,再到”训练系统”的时代。 思维的形态正在从孤立的长链推理(reasoning thinking),转向在与环境交互中持续行动的智能体思维(agentic thinking)。

1. o1 和 R1 的真正启示

OpenAI 的 o1 证明了”思考”可以作为一种一等能力来训练和展示;DeepSeek-R1 证明推理式后训练可以在原始实验室之外被复现和规模化

核心教训:要在语言模型中规模化 RL,需要确定性的、稳定的、可扩展的反馈信号。数学、代码、逻辑等可验证领域成为核心,因为其奖励信号远强于通用偏好监督

推理模型的涌现既是建模故事,也是基础设施故事 —— 需要大规模 rollout、高吞吐验证、稳定的策略更新和高效采样

第一次大转变:从扩展预训练到扩展推理后训练

2. “合并思考与指令模式”远比想象中困难

Qwen3 尝试将思考模式与指令模式统一(hybrid thinking mode ...